Introducción.

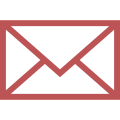

La conciencia, en sus múltiples definiciones, incluye el autoconocimiento, la percepción moral y la reflexión sobre la realidad. Desde Horacio (65 a.C.-8 a.C.) hasta la neurociencia moderna, su interpretación ha evolucionado, siendo ahora un punto central en el debate de la inteligencia artificial (IA). Por otro lado, la inteligencia, tanto humana como artificial, se entiende como la capacidad de aprender, razonar y adaptarse.

En las IA, esta inteligencia se emula a través de redes neuronales artificiales, donde millones de parámetros procesan información. Aunque avanzadas, estas carecen de conciencia y ética, operando exclusivamente según las reglas de sus algoritmos.

¿Cómo aprenden las máquinas?

Los sistemas de IA emplean métodos como aprendizaje: supervisado, no supervisado y por refuerzo.

A través de datos etiquetados, patrones no etiquetados y técnicas de prueba y error, las máquinas “aprenden” a interpretar su entorno. La retropropagaciones clave en este proceso, ajustando pesos y conexiones dentro de la red neuronal para optimizar sus resultados.

Sin embargo, este aprendizaje carece de intención o juicio moral. Todo depende de la calidad de los datos y la programación inicial, lo que abre las puertas a los sesgos.

El impacto de los sesgos

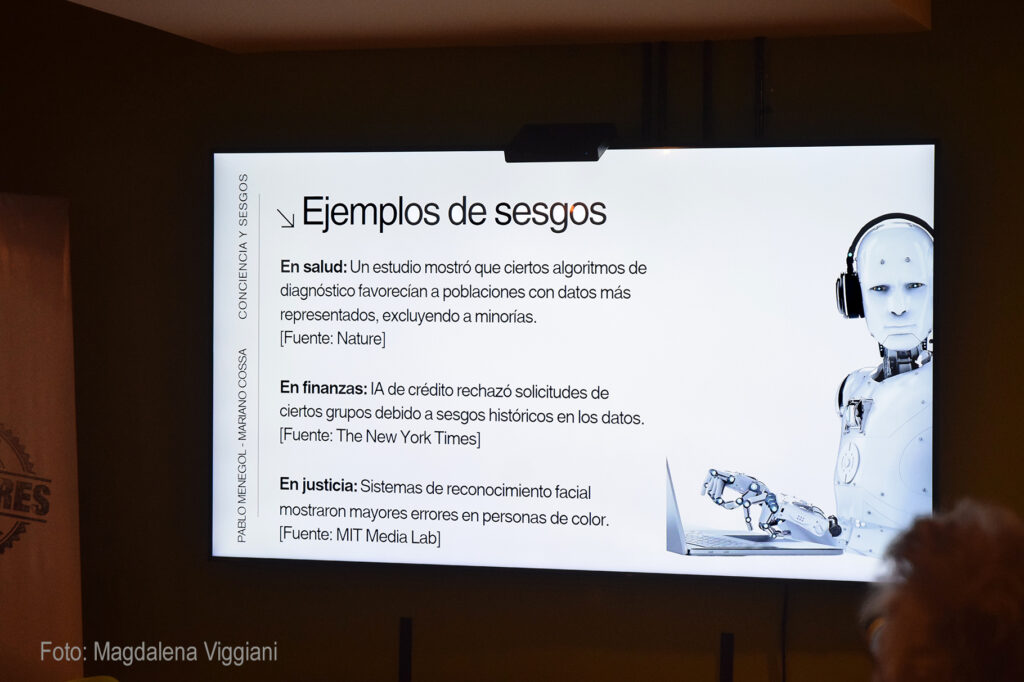

Los sesgos en IA son una de las problemáticas más críticas. Resultan de datos desbalanceados o diseños sesgados, replicando discriminaciones históricas. Ejemplos destacados incluyen:

* En salud: Diagnósticos sesgados hacia poblaciones mayoritarias.

* En finanzas: Rechazo de créditos basado en antecedentes discriminatorios.

* En justicia: Algoritmos de reconocimiento facial menos precisos en personas de color. Muchos otros que no tendríamos espacio en esta nota para enumerar.

Estos sesgos no solo perpetúan desigualdades, sino que también minan la confianza pública en estas tecnologías.

Ética y responsabilidad

Abordar los sesgos requiere soluciones éticas y técnicas. Entre las estrategias principales se encuentran:

1. Uso de datos representativos.

2. Auditorías y monitoreos constantes.

3. Equipos diversos que diseñen los algoritmos.

4. Inclusión de la sociedad civil en decisiones críticas.

La colaboración entre ingenieros, científicos sociales y legisladores será esencial para garantizar que estas tecnologías beneficien a todos por igual.

¿Tienen las IA conciencia?

Pueden distinguir entre “bueno” y “malo”, pero eso no es conciencia, es un algoritmo que un humano decidió que ese (bueno o malo) sea el resultado del algoritmo.

Aunque la IA puede imitar patrones humanos, carece de autoconciencia y moralidad. Su funcionamiento es resultado de procesos matemáticos, no de un entendimiento genuino del bien y el mal. Esto refuerza la necesidad de minimizar sesgos para evitar que estas tecnologías amplifiquen desigualdades.

Construyendo una IA justa.

Conclusión. Estamos a tiempo de redefinir la IA como una herramienta inclusiva y ética. Este esfuerzo requiere no solo innovación tecnológica, sino también una reflexión profunda sobre cómo modelamos estas máquinas para que reflejen lo mejor de nosotros y legislación que controle cómo se programan las AIs que manejamos a diario.

Pablo Menegol